AI coding tools đang tăng tốc quá trình phát triển phần mềm theo cách mà vài năm trước còn rất khó tưởng tượng. Chỉ với một prompt, nhóm kỹ thuật có thể tạo ra function mới, sửa API, viết test, thậm chí tái cấu trúc một module tương đối lớn. Nhưng câu hỏi khó nhất không phải là AI viết nhanh đến đâu. Câu hỏi thật sự là: khi đầu ra sai, ai chịu trách nhiệm và bằng cách nào đội ngũ có thể kiểm soát rủi ro đó?

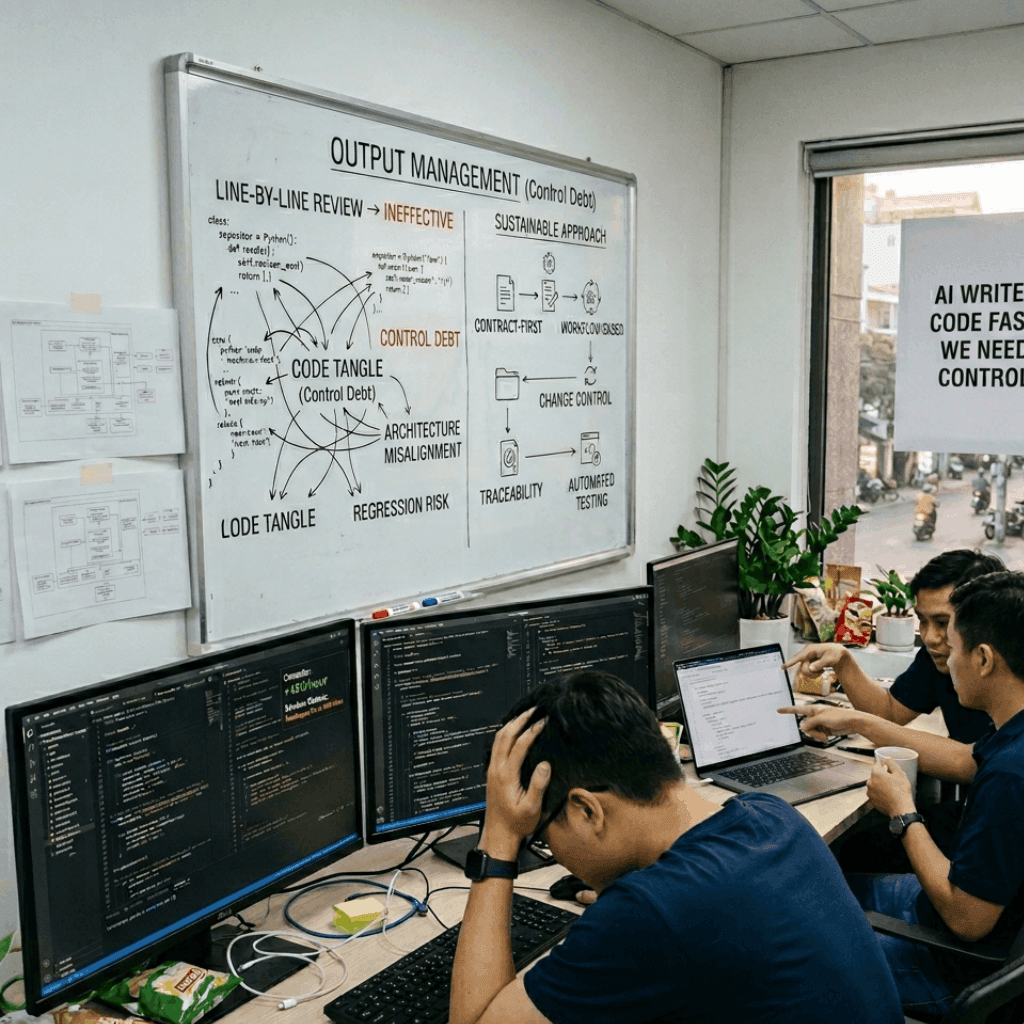

Nỗi đau thật trong đội kỹ thuật không nằm ở việc xuất hiện thêm vài đoạn code chưa đẹp. Nỗi đau nằm ở việc tốc độ sinh mã tăng lên quá nhanh trong khi năng lực kiểm soát đầu ra gần như không tăng tương ứng. Kết quả là đội ngũ có cảm giác đang đi nhanh hơn, nhưng thực chất đang tích lũy một dạng nợ kiểm soát mới: khó lần vết, khó xác minh ý định, khó đánh giá tác động dây chuyền, và rất dễ hồi quy ở những nơi tưởng như không liên quan.

Tốc độ cao không tự động tạo ra năng suất bền vững

Phần lớn AI coding tools hiện nay giải quyết rất tốt bài toán tạo mã. Chúng giúp rút ngắn thời gian từ ý tưởng đến bản nháp đầu tiên, giảm ma sát khi bắt đầu, và khiến nhiều tác vụ lặp lại trở nên rẻ hơn. Nhưng càng tạo mã nhanh, đội kỹ thuật càng phải trả giá đắt hơn cho câu hỏi kiểm soát: đoạn mã này được sinh ra từ giả định nào, đang thay đổi contract nào, ảnh hưởng đến workflow nào, và có phá vỡ cam kết nào với hệ thống hiện hữu hay không?

Nếu không trả lời được những câu hỏi đó một cách có hệ thống, tốc độ sẽ biến thành áp lực. Đội ngũ có thể ship nhiều hơn trong ngắn hạn, nhưng càng về sau càng khó tự tin khi chỉnh sửa, khó debug khi có sự cố, và khó truy trách nhiệm khi một thay đổi nhỏ gây ra lỗi lớn. Đây là lý do vì sao nhiều tổ chức bắt đầu thấy rằng vấn đề của AI coding hiện nay không nằm ở chất lượng cú pháp, mà nằm ở việc không có cơ chế chịu trách nhiệm cho đầu ra.

Vì sao review theo từng dòng không còn đủ

Trong mô hình phát triển truyền thống, human review hoạt động tương đối hiệu quả vì tốc độ thay đổi còn nằm trong khả năng hấp thụ của reviewer. Một pull request có thể đủ nhỏ để đọc, hiểu, đối chiếu với bối cảnh, rồi phản biện từng phần. Nhưng khi AI có thể sinh ra khối lượng code lớn trong thời gian rất ngắn, review theo kiểu line-by-line bắt đầu mất tác dụng.

Không phải vì reviewer kém hơn, mà vì bài toán đã đổi bản chất. Một reviewer giỏi vẫn có thể nhìn thấy code smell, naming issue hay logic rõ ràng bị sai. Nhưng reviewer rất khó suy luận đầy đủ về ý định gốc, tác động kiến trúc, thay đổi ngầm trong luồng nghiệp vụ, và các rủi ro hồi quy nếu mọi thứ chỉ được biểu diễn dưới dạng diff. Nói cách khác, human review không scale khi lượng mã tăng quá nhanh mà ngữ cảnh lại bị nén xuống vài comment và vài file thay đổi.

Khi đội ngũ vẫn cố bám vào review line diff như hàng rào kiểm soát chính, họ thường rơi vào hai thái cực: hoặc review qua loa để kịp tiến độ, hoặc review quá lâu đến mức mất lợi thế tốc độ. Cả hai đều không giải quyết gốc rễ.

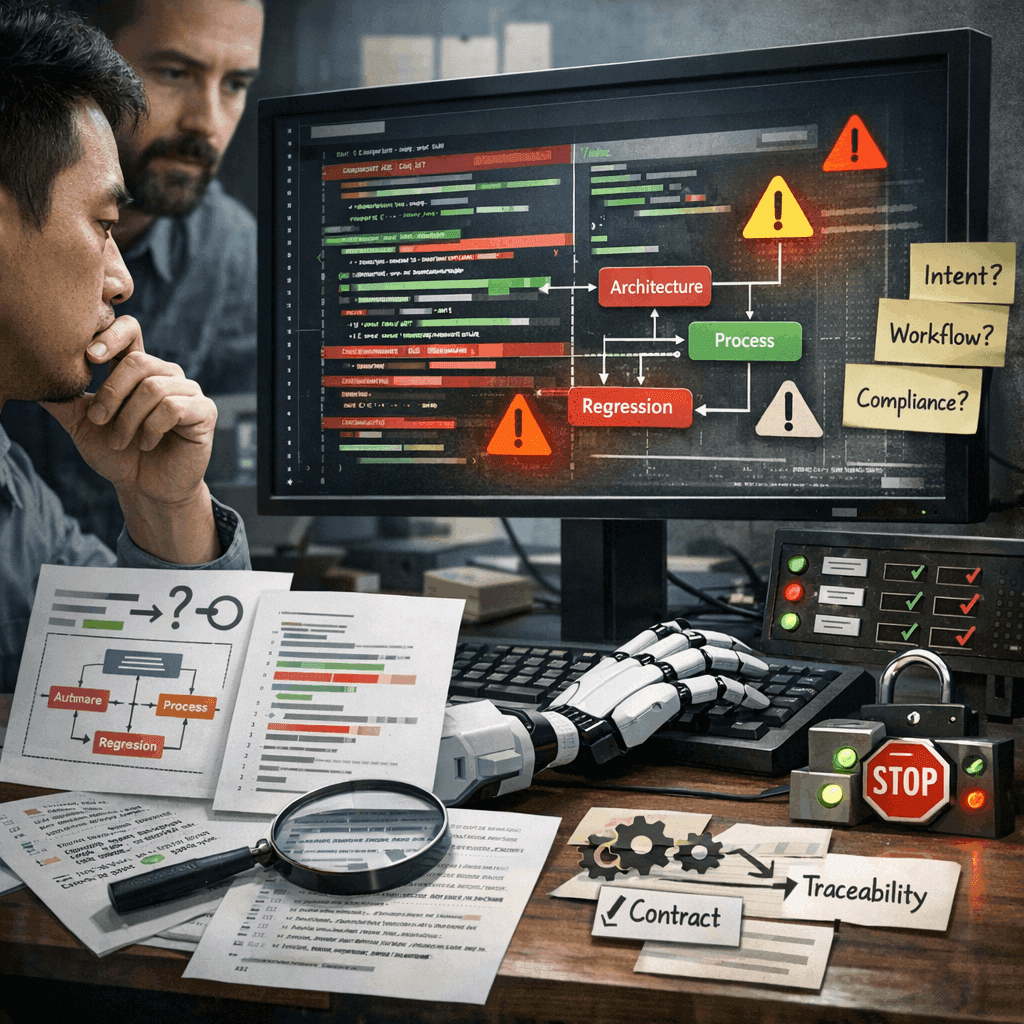

Bốn kiểu rủi ro phổ biến khi AI sinh mã

1. Lệch ý định

AI có thể tạo ra đoạn mã trông hợp lý nhưng không đúng với ý định nghiệp vụ ban đầu. Đây là kiểu sai nguy hiểm vì code vẫn chạy, test cục bộ vẫn có thể pass, nhưng sản phẩm lại hành xử sai ở tình huống thực tế. Khi thiếu contract-first hoặc mô tả đầu vào đầu ra rõ ràng, AI rất dễ lấp khoảng trống bằng suy đoán.

2. Lệch kiến trúc

Một thay đổi được sinh ra để giải quyết nhanh một yêu cầu cụ thể có thể vô tình đi ngược lại nguyên tắc kiến trúc của hệ thống. Ví dụ, logic đáng lẽ phải nằm ở domain service lại bị đẩy vào controller, hoặc một dependency tạm thời được thêm vào làm tăng coupling giữa các module. Từng thay đổi riêng lẻ có vẻ nhỏ, nhưng cộng dồn lại sẽ bào mòn cấu trúc hệ thống.

3. Lệch quy trình

Nhiều lỗi không nằm trong code mà nằm ở việc code đi lệch khỏi quy trình kỹ thuật: thiếu traceability, thiếu liên kết với ticket, thiếu cập nhật contract, thiếu mapping giữa yêu cầu và test, hoặc bỏ qua các bước kiểm tra bắt buộc. AI coding tools thường tối ưu cho việc sinh mã, không tự nhiên tối ưu cho việc tuân thủ quy trình nếu workflow không ép buộc điều đó.

4. Hồi quy

Regression là nơi đội kỹ thuật trả học phí đắt nhất. Một thay đổi nhỏ ở validation, cache, serialization hay naming có thể làm hỏng một hành vi cũ vốn đang phục vụ nhiều luồng khác nhau. Càng nhiều code được sinh nhanh, xác suất tạo hồi quy càng tăng nếu không có cơ chế phát hiện tác động liên kết giữa thay đổi, contract và test.

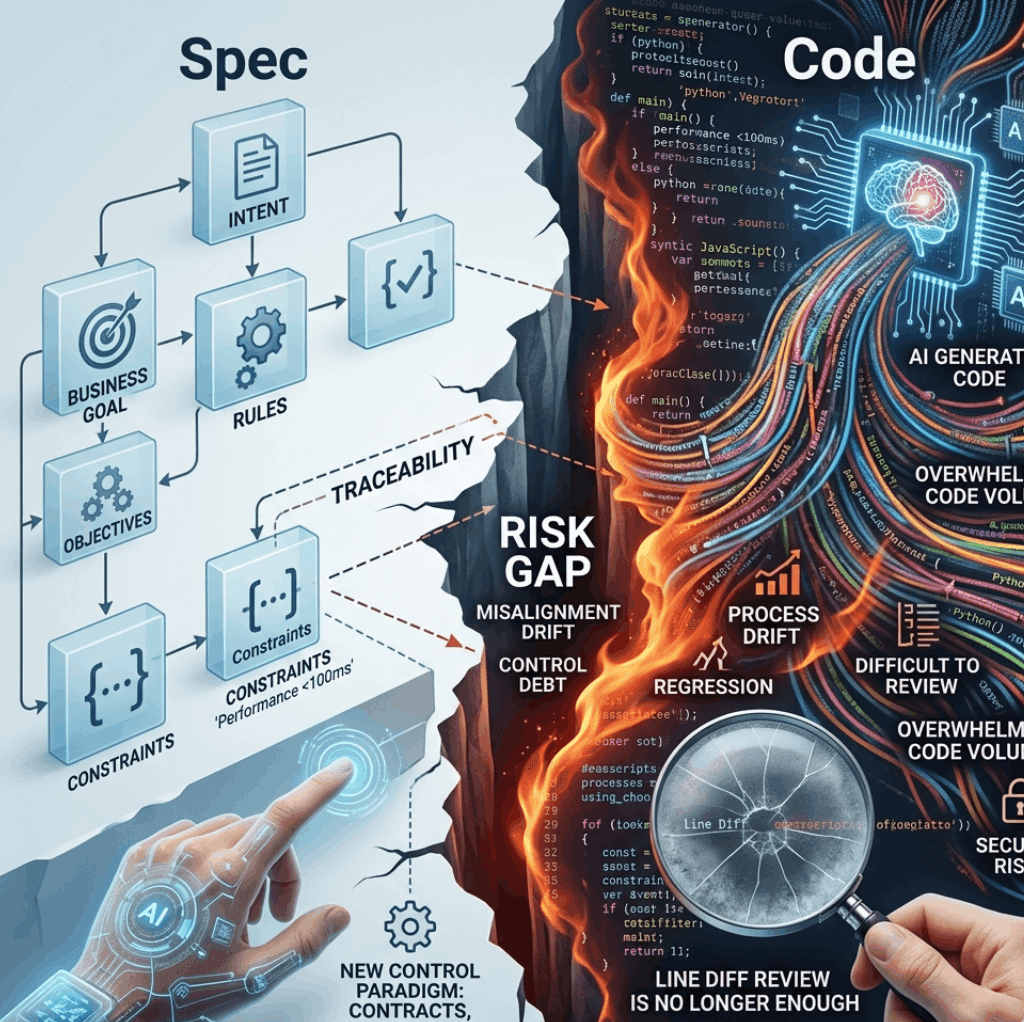

Vấn đề cần được nhìn ở cấp workflow, không chỉ ở cấp code

Khi nói AI coding tools không chịu trách nhiệm đầu ra, nhiều người có xu hướng quy vấn đề về chuyện model chưa đủ tốt. Nhưng ngay cả khi model tốt hơn, bài toán chịu trách nhiệm vẫn không tự biến mất. Lý do là trách nhiệm đầu ra không nằm ở việc một đoạn code có vẻ đúng hay không; nó nằm ở việc thay đổi đó có thể được kiểm soát xuyên suốt từ yêu cầu, contract, implementation, test đến triển khai hay không.

Đây là lúc đội kỹ thuật cần chuyển góc nhìn từ line diff sang workflow. Thay vì chỉ hỏi “code này có ổn không”, cần hỏi thêm:

- Thay đổi này đang thực hiện yêu cầu nào?

- Contract nào là nguồn sự thật của thay đổi?

- Các thành phần bị ảnh hưởng là gì?

- Test nào xác nhận đúng ý định thay vì chỉ xác nhận không lỗi cú pháp?

- Ai có thể lần vết từ sự cố ngược về thay đổi, rồi ngược tiếp về yêu cầu ban đầu?

Nếu không có traceability, mọi thứ sẽ phụ thuộc vào trí nhớ của con người và thiện chí của reviewer. Cách làm đó không phù hợp với môi trường có AI tham gia sinh mã ở quy mô lớn.

Ví dụ: một thay đổi nhỏ nhưng tác động dây chuyền

Hãy tưởng tượng một AI assistant được yêu cầu “đơn giản hóa response của API tạo đơn hàng”. Công cụ quyết định đổi tên trường customer_phone thành phone cho gọn hơn, đồng thời gom một số mapping vào helper dùng chung. Pull request nhìn khá sạch, test unit mới vẫn pass, reviewer đọc nhanh thấy hợp lý.

Nhưng phía sau thay đổi nhỏ đó là hàng loạt hệ quả: một dịch vụ đồng bộ dữ liệu sang CRM đang đọc đúng trường cũ, một job phân tích conversion dùng schema cũ, tài liệu tích hợp cho đối tác chưa được cập nhật, và một rule masking dữ liệu cá nhân ở logging đang match theo tên trường cũ. Kết quả là không chỉ API thay đổi, mà cả chuỗi vận hành, phân tích, bảo mật và tích hợp đều bị ảnh hưởng.

Đây không phải lỗi vì AI “viết code dở”. Đây là lỗi vì workflow không buộc thay đổi phải bám theo contract, không làm rõ vùng ảnh hưởng, và không tạo đủ traceability để người review nhìn thấy toàn bộ bức tranh. Nếu chỉ xem diff, thay đổi đó rất dễ được chấp nhận. Nếu nhìn ở cấp workflow, rủi ro sẽ lộ ra sớm hơn nhiều.

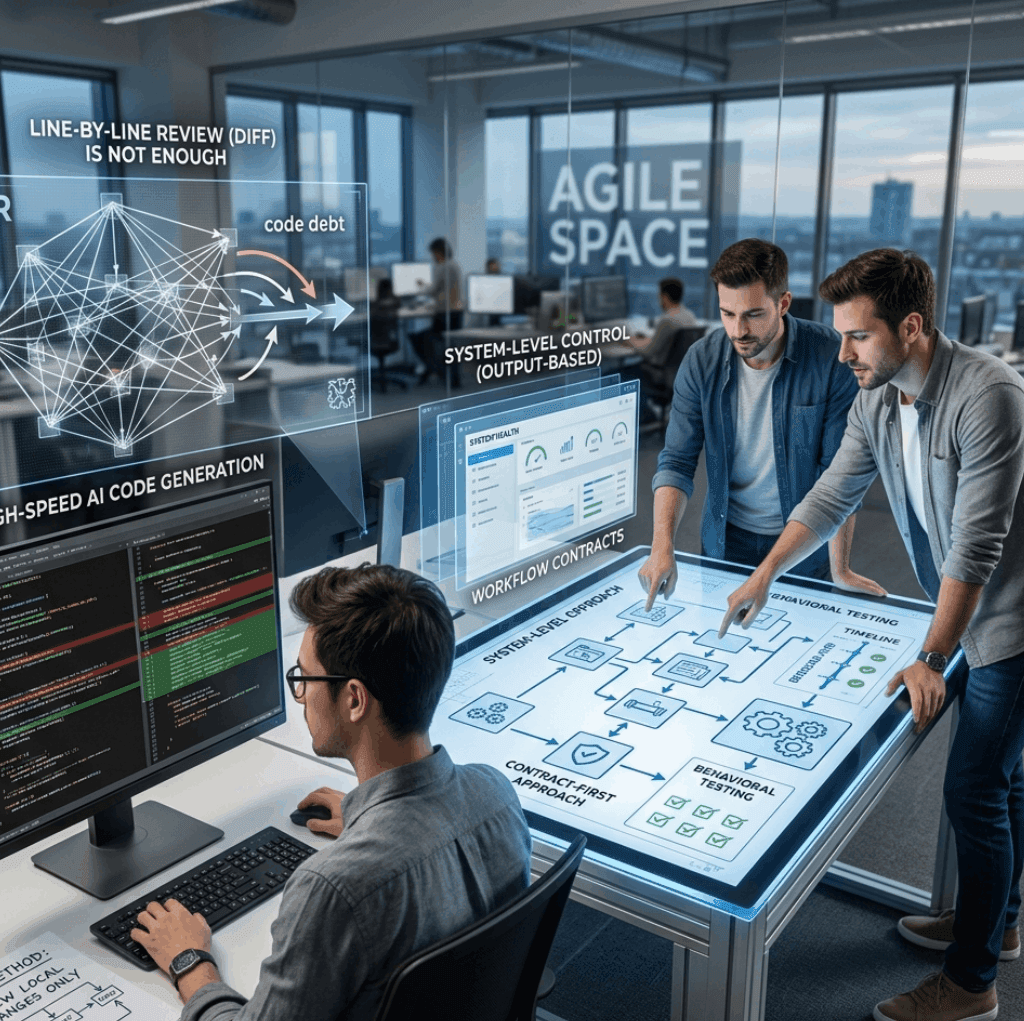

Từ vibe coding đến contract coding

Vibe coding hấp dẫn vì nó mang lại cảm giác trôi chảy: nghĩ gì, nói ra, có code ngay. Nhưng cảm giác đó dễ đánh đồng tốc độ với kiểm soát. Ở quy mô cá nhân hoặc thử nghiệm nhỏ, vibe coding có thể đủ tốt. Ở môi trường sản phẩm thật, nơi một thay đổi phải đi qua nhiều lớp nghiệp vụ và vận hành, đội kỹ thuật cần một cách làm chắc hơn.

Một hướng tiếp cận tốt hơn là contract-first hoặc contract coding: xác định rõ cam kết đầu vào, đầu ra, hành vi và ranh giới trước khi sinh mã ở quy mô lớn. Khi contract là trung tâm, AI không còn chỉ “viết thứ có vẻ đúng”, mà phải phục vụ một cấu trúc có thể kiểm tra, truy vết và đối chiếu. Điều này đặc biệt quan trọng trong các mô hình software factory, nơi nhiều thay đổi được tạo song song và cần tính nhất quán cao.

Contract-first không làm mất lợi thế tốc độ của AI. Ngược lại, nó chuyển tốc độ từ dạng bốc đồng sang dạng có kiểm soát. Thay vì để reviewer làm chốt chặn cuối cùng cho mọi rủi ro, tổ chức có thể phân phối trách nhiệm vào đúng nơi: contract làm rõ ý định, workflow đảm bảo tuân thủ, traceability giúp lần vết, còn review tập trung vào quyết định kỹ thuật thực sự quan trọng.

Điều đội kỹ thuật cần không phải thêm một reviewer

Khi chất lượng đầu ra giảm, phản xạ phổ biến là thêm review, thêm checklist, thêm người duyệt. Nhưng nếu cơ chế nền tảng vẫn là “để con người đọc hết mọi thứ”, hệ thống đó sớm muộn cũng nghẽn. Human review là cần thiết, nhưng không thể là giải pháp duy nhất khi AI đang nhân tốc độ tạo mã lên nhiều lần.

Điều đội kỹ thuật cần là một workflow khiến việc sinh mã phải đi kèm khả năng kiểm soát đầu ra. Nghĩa là mỗi thay đổi phải gắn được với ý định, contract, phạm vi ảnh hưởng, kiểm thử liên quan và dấu vết triển khai. Khi đó, con người không còn phải đóng vai máy quét toàn năng, mà có thể tập trung vào quyết định kiến trúc, rủi ro nghiệp vụ và những ngoại lệ phức tạp.

Kết luận

Nói rằng AI coding tools không chịu trách nhiệm đầu ra là đúng, nhưng chưa đủ. Vấn đề thật không nằm ở việc công cụ vô trách nhiệm, mà ở chỗ nhiều đội kỹ thuật vẫn đang dùng chúng trong một hệ thống phát triển chưa được thiết kế để kiểm soát tốc độ mới. Khi đầu ra tăng nhanh hơn năng lực xác minh, nợ kiểm soát sẽ tích tụ và bùng phát dưới dạng regression, lệch ý định, lệch kiến trúc và đứt gãy quy trình.

Vì vậy, trọng tâm cần dịch chuyển từ sinh mã sang kiểm soát đầu ra. Từ vibe coding sang contract coding. Từ review line diff sang quản trị workflow. Từ cảm giác “code chạy được” sang khả năng chứng minh “thay đổi này đúng, an toàn và có thể lần vết”. Chỉ khi đó AI mới thực sự trở thành lực khuếch đại năng suất, thay vì lực khuếch đại rủi ro.